OpenAI, Anthropic und Google verbünden sich gegen chinesisches Modell-Kopieren

OpenAI, Anthropic und Google teilen erstmals Informationen, um Modell-Kopieren durch chinesische KI-Firmen zu blockieren.

in

PARTNER · INOO GMBH

Wie viel KI verträgt dein Betrieb? In 30 Minuten Klartext.

Kostenloses Erstgespräch — herstellerneutral, direkt aus dem Rheintal.

Gespräch buchen →

DAS WICHTIGSTE IN KÜRZE

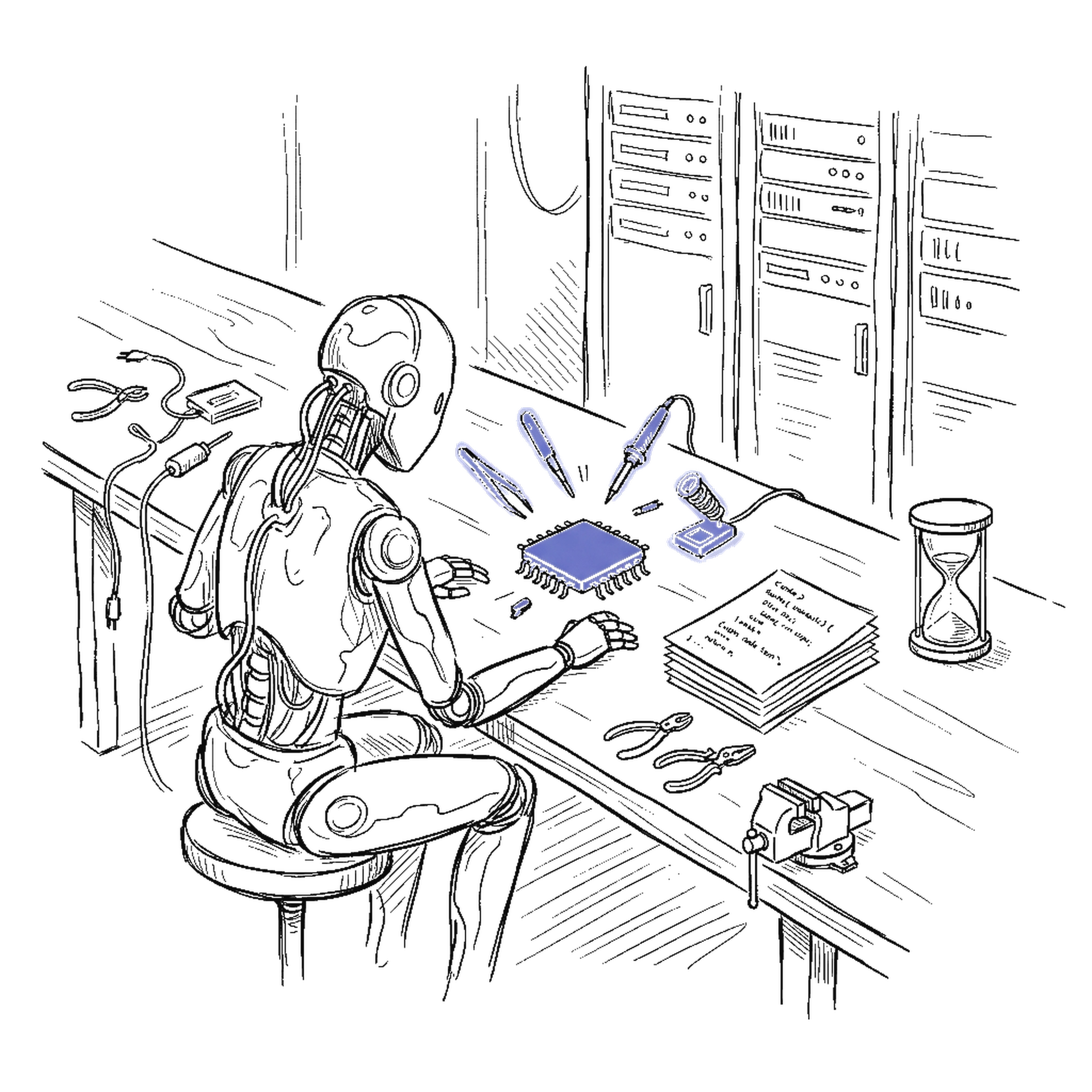

Die KI-Branche bewegt sich von Wettbewerb zu koordinierter Verteidigung gegen staatlich unterstütztes Modell-Kopieren.

Die drei grössten westlichen KI-Labore teilen erstmals systematisch Informationen, um das Kopieren ihrer Modelle durch chinesische KI-Firmen zu erkennen und zu blockieren. Im Visier: DeepSeek, Moonshot AI und MiniMax.

Anthropic dokumentierte 16 Millionen unautorisierte Abfragen von rund 24'000 betrügerischen Accounts. Die Aufschlüsselung zeigt das Ausmass: MiniMax allein war für über 13 Millionen Anfragen verantwortlich, Moonshot AI für über 3,4 Millionen, DeepSeek für etwa 150'000. Die Firmen nutzten Fake-Accounts und Proxy-Dienste mit sogenannten «Hydra-Cluster»-Architekturen, um die Erkennung zu umgehen.

Die Kooperation läuft über das Frontier Model Forum – ein Konsortium, das OpenAI, Anthropic, Google und Microsoft 2023 gegründet hatten. Das Ziel: sogenannte «adversarial distillation» erkennen, also das systematische Abfragen von Modellen, um deren Wissen in eigene, kleinere Modelle zu extrahieren.

Die KI-Branche bewegt sich damit von reinem Wettbewerb zu koordinierter Verteidigung gegen staatlich unterstütztes Modell-Kopieren – ein neues Kapitel im technologischen Wettstreit zwischen den USA und China.