KI-Politik, Governance, AI Safety und ethische Debatten – vom EU AI Act bis zur globalen KI-Regulierung.

Anthropic-CEO Amodei warnt: Sechs bis zwölf Monate Zeit, bevor chinesische KI gleichzieht. Mythos liefert nicht nur Schwachstellen, sondern den lauffähigen Exploit gleich mit.

Patch-Geschwindigkeit wird zum Wettbewerbsfaktor – wer Updates über Tage liegen lässt, fängt sich KI-generierte Exploits ein.

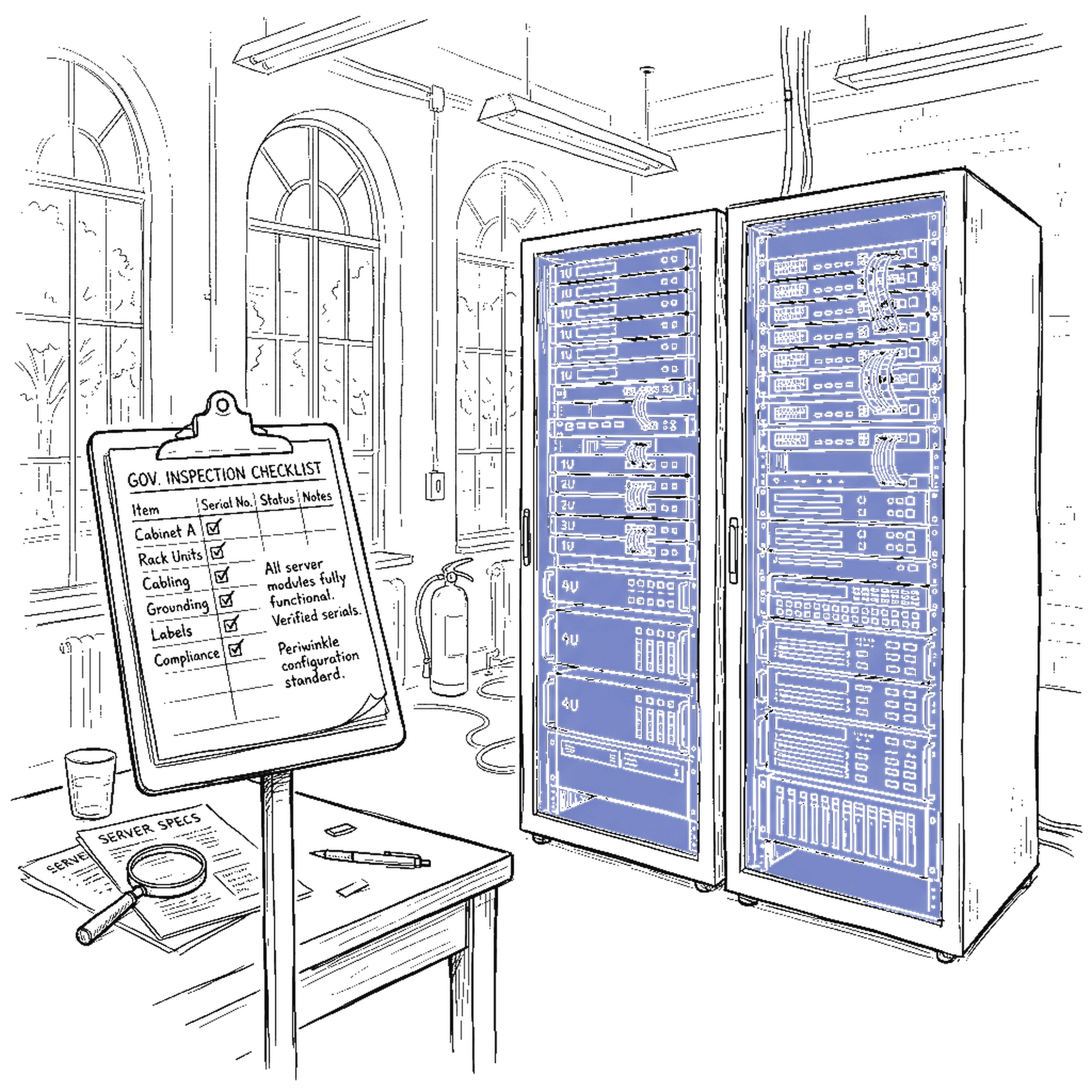

Das Center for AI Standards and Innovation bekommt Pre-Deployment-Zugriff auf Frontier-Modelle der drei Labs. Was heute Goodwill ist, wird über Pentagon-Verträge bald zur Norm.

Aus freiwilligen Sicherheits-Tests werden über Pentagon-Verträge Quasi-Markteintritts-Bedingungen.

Anthropic und OpenAI haben am selben Tag konkurrierende Enterprise-Vehikel mit Wall Street verkündet. Anthropic baut mit Blackstone, Goldman und Hellman & Friedman eine 1,5-Mrd.-Firma; OpenAI startet mit TPG, Bain und SoftBank «The Deployment Company» mit 10 Mrd. Bewertung – und garantiert Investoren 17,5% Rendite pro Jahr.

Beide Labs schalten die KI-Beratungsindustrie aus und verkaufen ein Stück ihrer Enterprise-Marge an Private-Equity-Häuser, um direkten Zugang zu deren Portfolio-Firmen zu bekommen.

OpenAI aktiviert für Free-Konten standardmässig Marketing-Cookies. Cookie-IDs und E-Mail-Adressen wandern an Werbepartner – Plus- und Enterprise-Accounts bleiben verschont. Was das für dich heisst und wie du den Schalter umlegst.

OpenAI dreht den Datenschutz-Default um: Free-Nutzer werden ohne aktive Zustimmung zur Werbe-Pipeline – Plus und Enterprise nicht.

Das britische AI Safety Institute hat OpenAIs GPT-5.5 einem harten Cyber-Stresstest unterzogen. Das Ergebnis: Das Modell schliesst auf Anthropics Mythos auf – und löst die nächste Welle von Sicherheitsfragen aus. Was Schweizer CISOs jetzt wissen müssen.

Mit GPT-5.5 erreicht ein zweites Frontier-Modell das Cyber-Offensiv-Niveau von Mythos – defensive Vorbereitung muss sich an der ganzen Modellklasse ausrichten, nicht mehr an einzelnen Anbietern.

Anthropic hat Claude Security als Public Beta für Enterprise-Kunden gestartet. Das auf Opus 4.7 basierende Tool scannt Code-Repositories, validiert Schwachstellen und liefert Patch-Vorschläge – die direkt in Claude Code übernommen werden können. CrowdStrike, Microsoft Security, Palo Alto, SentinelOne, TrendAI und Wiz integrieren parallel Opus 4.7.

Wenn Mythos die Offensive industrialisiert, ist Claude Security die Defensive – Anthropics Antwort auf die eigene Zero-Day-Welle und ein neuer Standard für Software-Security-Workflows in 2026.

Das US-Verteidigungsministerium hat am 1. Mai Vereinbarungen mit sieben grossen KI-Anbietern – SpaceX, OpenAI, Google, Nvidia, Reflection AI, Microsoft und AWS – für klassifizierte Netzwerke (Impact Level 6/7) bekanntgegeben. Anthropic, zuvor wegen Guardrail-Streit als «Supply-Chain Risk» geführt, fehlt explizit.

Mit dem Ausschluss von Anthropic wird die ethische Differenzierung der KI-Anbieter institutionell sichtbar – Schweizer Bundesverwaltung und regulierte Branchen bekommen damit einen klaren Werte-Filter für ihre Provider-Wahl.

Eine Beobachter-Recherche von Otto Hostettler und Lukas Lippert deckt auf: Rund 100 ETH- und EPFL-Wissenschaftler warnten das Schweizer Parlament im Sommer 2025 vor «zu strengen» KI-Gesetzen. Ihre Hochschulen erhalten Millionen von Meta, Google und ByteDance.

Akademisches Lobbying gegen Schweizer KI-Regulierung kommt von Forschern, deren Hochschulen Millionen von genau jenen Konzernen erhalten, die zu regulieren sind. Eine Story, die Schweizer Politik und Forschungs-Community gleichermassen beschäftigt.

Der Zivilprozess Musk vs. OpenAI/Altman/Brockman/Microsoft startete am 28. April in Oakland mit Eröffnungsplädoyers. Musk fordert 130 Mrd. Dollar Schadenersatz, die Rückwandlung von OpenAI in eine Non-Profit-Struktur, sowie die Absetzung von Altman und Brockman.

Auch wenn der Prozess als «Musk-Show» abgetan wird – die juristische Frage, ob eine Non-Profit-Charity in eine For-Profit-Struktur überführt werden darf, schafft Präzedenz für die gesamte KI-Branche.

Google hat einen Vertrag mit dem US-Verteidigungsministerium unterzeichnet, der Gemini für klassifizierte Militäraufgaben freigibt – einen Tag, nachdem über 580 Mitarbeitende in einem offenen Brief an Sundar Pichai genau das ablehnten. Der Vertrag spiegelt die Konditionen, die Anthropic im Februar abgelehnt hatte.

Mit Googles Pentagon-Deal ist die «AI for Good»-Selbstbeschränkung der grossen US-Labs faktisch beendet – ausser bei Anthropic. Schweizer Compliance-Verantwortliche bekommen damit ein neues Differenzierungsmerkmal bei der Provider-Wahl.

Der zweite und voraussichtlich entscheidende Trilog zum Digital Omnibus on AI tagt heute in Strassburg. Konsens steht bei den fixen Stichtagen 2. Dezember 2027 (Hochrisiko Annex III) und 2. August 2028 (eingebettete KI Annex I). Streitpunkte: Watermarking-Frist, Annex-I-Verlagerung, AI-Office-Inspektionen.

Die fixen EU-Stichtage stehen, aber Watermarking, Sektor-Recht und AI-Literacy bleiben offene Streitpunkte – Schweizer Anbieter im EU-Markt sollten ihre Compliance-Roadmap auf 2027/2028 ausrichten.

Anthropic eröffnete am 27. April offiziell sein Sydney-Büro und ernannte Theo Hourmouzis (Ex-Snowflake SVP APAC) zum General Manager Australia & New Zealand. Parallel weitet Florida AG James Uthmeier seine Strafuntersuchung gegen OpenAI aus – die zweite formelle Vorladung wird vorbereitet.

Während Anthropic geographisch wächst, gerät OpenAI juristisch unter Druck – zwei Frontier-Labs, zwei sehr unterschiedliche Stories diese Woche.