Mistral hat Medium 3.5 ausgerollt – ein dichtes 128B-Modell mit 256k Kontext, das Chat, Reasoning und Coding in einem einzigen Set Gewichte vereint. 77,6 Prozent auf SWE-Bench, offene Gewichte unter modifizierter MIT-Lizenz und neue Cloud-Agenten in Vibe und Le Chat.

Mistral Medium 3.5 schlägt Devstral 2 und positioniert Europa mit offenen Gewichten und kompakter 4-GPU-Architektur als Coding-Frontier-Alternative zu OpenAI und Anthropic.

Mistral hat sein neues Flagship vorgestellt – und damit gleich die ganze Coding-Pipeline neu gedacht. Mistral Medium 3.5 ist ein dichtes 128-Milliarden-Parameter-Modell mit 256k Kontextfenster, das Chat, Reasoning und Coding in einem einzigen Set Gewichte vereint. Veröffentlicht wurde es Ende April mit offenen Gewichten unter modifizierter MIT-Lizenz, gerade jetzt am Wochenende kommen die agentischen Aufsätze dazu.

Auf dem SWE-Bench Verified-Benchmark – dem Industriestandard für autonome Software-Engineering-Aufgaben – erreicht Medium 3.5 stolze 77,6 Prozent. Damit lässt es Mistrals eigenen Coding-Spezialisten Devstral 2 hinter sich und schlägt auch grössere Open-Weight-Konkurrenten wie Qwen3.5 397B. Der Reasoning-Aufwand ist pro Anfrage konfigurierbar: Schnelle Chat-Antwort oder mehrstufige agentische Schleife – alles dasselbe Modell.

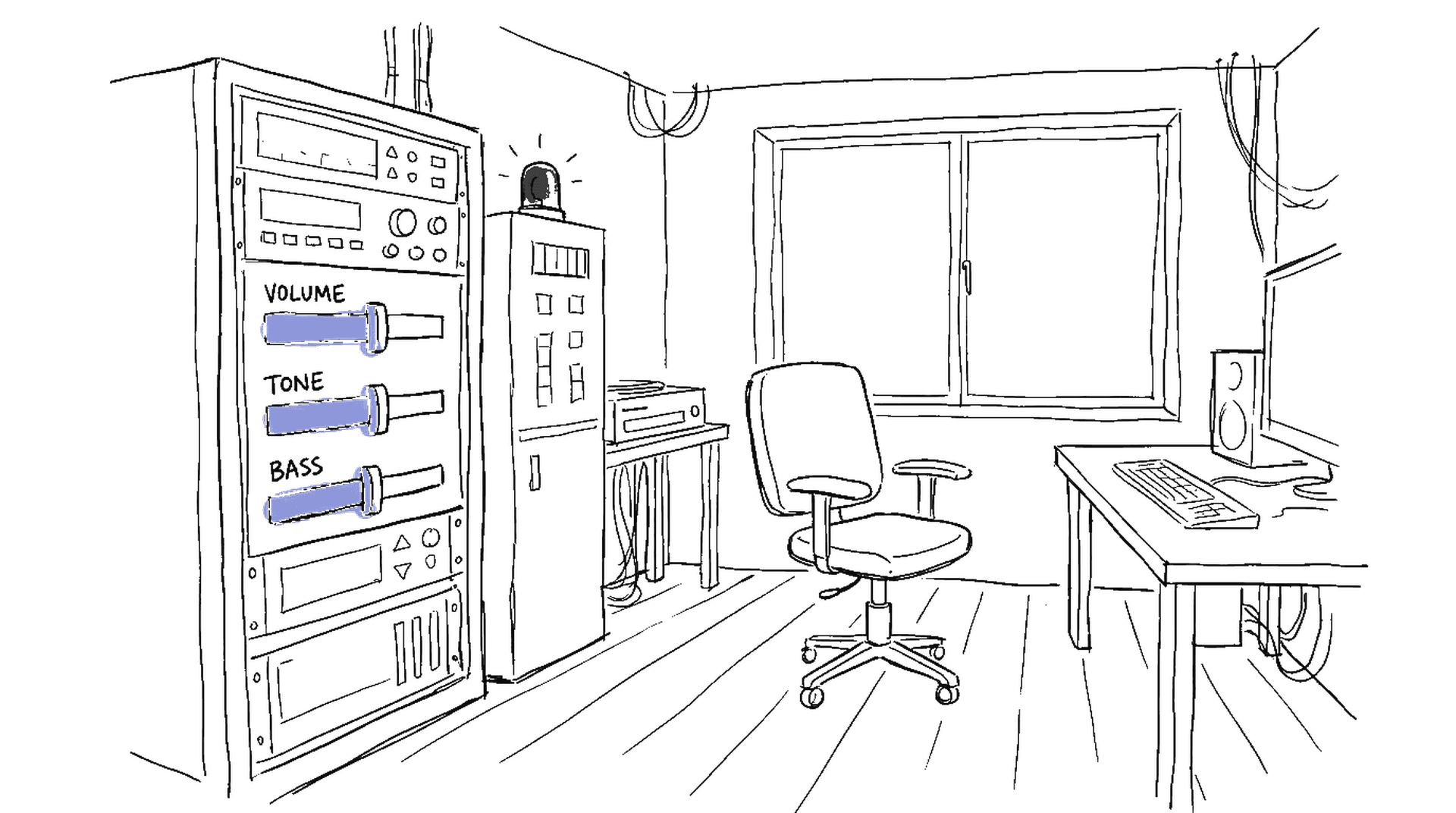

Konkret heisst das: Du brauchst nicht mehr drei verschiedene Modelle für drei verschiedene Use Cases. Bemerkenswert ist auch die Effizienz – Medium 3.5 läuft bereits auf vier GPUs, sowohl on-prem als auch in der Cloud.

Parallel zum Modell hat Mistral Remote Agents in Vibe lanciert. Statt Schritt-für-Schritt im Editor zu arbeiten, schickst du eine Aufgabe per CLI oder Le Chat in die Cloud, läufst mehrere Coding-Jobs parallel und bekommst eine Notification, wenn die Pull Request bereit liegt. Das Konzept entspricht dem, was Anthropic mit Claude Code Routines und OpenAI mit Codex Cloud-Tasks vormacht – Mistral zieht jetzt nach, ohne dafür proprietäre US-Infrastruktur zu brauchen.

Der dritte Baustein ist Work Mode in Le Chat, ebenfalls auf Medium 3.5 aufgesetzt. Der Modus arbeitet sich durch mehrstufige Aufgaben, ruft Tools parallel auf und bündelt typische Cross-Tool-Workflows: E-Mail, Messages und Kalender in einem Aufschlag durchgehen, Recherchen quer über Web und interne Dokumente fahren. Verfügbar ist Work Mode für Pro-, Team- und Enterprise-Kunden.

Mit Medium 3.5 muss Mistral nicht mehr drei Modelle hochziehen – Chat, Reasoning, Code laufen jetzt aus demselben Stamm.

Über die API kostet Medium 3.5 1,50 Dollar pro Million Input-Tokens und 7,50 Dollar Output. Das positioniert es deutlich unter Claude Sonnet 4.5 oder GPT-5.5, bei vergleichbaren oder besseren Coding-Werten. Die Kombination aus offenen Gewichten, kompakter Architektur und Cloud-Agenten zeigt, wo Europas Antwort auf das amerikanische Frontier-Tempo hinwill: nicht grösser, sondern besser geschnitten.

Mistral Medium 3.5 schlägt Devstral 2 und positioniert Europa mit offenen Gewichten und kompakter 4-GPU-Architektur als Coding-Frontier-Alternative zu OpenAI und Anthropic.

OpenAI hat drei neue Voice-Modelle veröffentlicht: GPT-Realtime-2 mit GPT-5-Reasoning, GPT-Realtime-Translate für Live-Übersetzung in 70 Sprachen und GPT-Realtime-Whisper für Streaming-Transkription. Voice ist damit nicht mehr Demo-Feature, sondern operativer Bauklotz für Produkte.

Drei API-Endpunkte – Reasoning-Voice, Live-Translation und Streaming-Transkription – die das Voice-Modell zum echten Produkt-Bauklotz machen.

Anthropic hat einen Compute-Deal mit SpaceX über die volle Kapazität des Colossus-1-Datacenters in Memphis verkündet: 300 Megawatt, über 220'000 NVIDIA-GPUs. Parallel verdoppeln sich die 5h-Limits in Claude Code, die Peak-Hour-Drosselung fällt weg, und API-Limits für Opus steigen massiv. Im Vertrag versteckt: Interesse an orbitaler Compute-Kapazität.

Mehr Compute, weniger Limits, härteres Statement im Compute-Wettrüsten – und Musks SpaceX als unerwarteter Lieferant.

OpenAI hat GPT-5.5 Instant ausgerollt: 52,5 % weniger Halluzinationen bei heiklen Themen und ein neues Memory-Sources-Feature, das endlich offenlegt, woran sich ChatGPT erinnert. Das Modell ist neuer Default in ChatGPT.

GPT-5.5 Instant ist der neue ChatGPT-Default mit 52,5 % weniger Halluzinationen und transparentem «Memory Sources»-Feature.