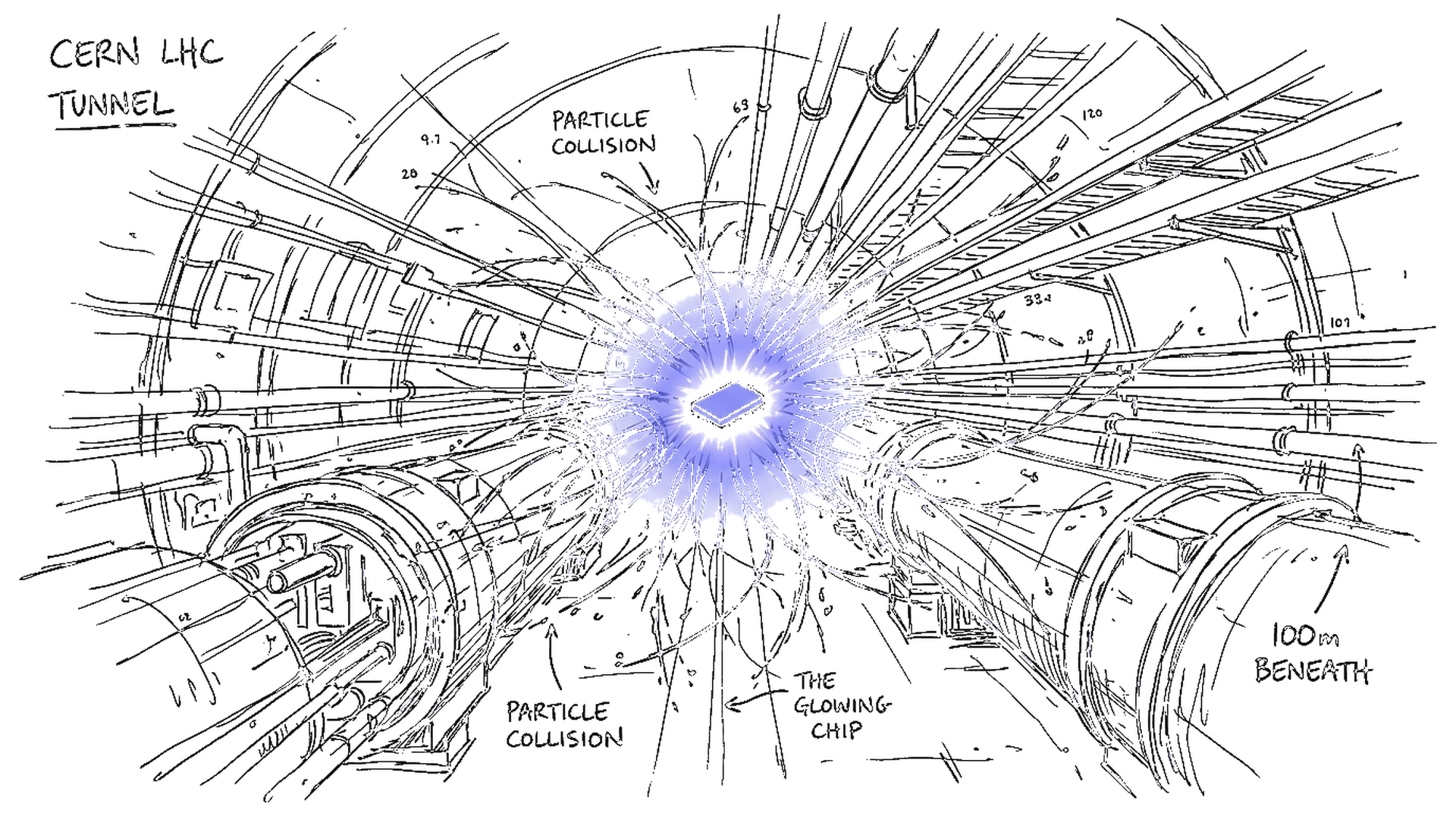

CERN brennt winzige KI-Modelle in Silizium – mit unter 50 Nanosekunden Latenz

Während die KI-Branche immer grössere Modelle baut, geht CERN den umgekehrten Weg: Ultrakompakte KI-Modelle, physisch in FPGAs eingebrannt, filtern die gewaltige Datenmenge des Large Hadron Collider in Echtzeit.

INHALT

INHALT

in

PARTNER · INOO GMBH

Wie viel KI verträgt dein Betrieb? In 30 Minuten Klartext.

Kostenloses Erstgespräch — herstellerneutral, direkt aus dem Rheintal.

Gespräch buchen →

DAS WICHTIGSTE IN KÜRZE

Nicht jedes Problem braucht ein 1-Billion-Parameter-Modell – manchmal reicht ein Entscheidungsbaum in Silizium, wenn man das Problem gut genug versteht.

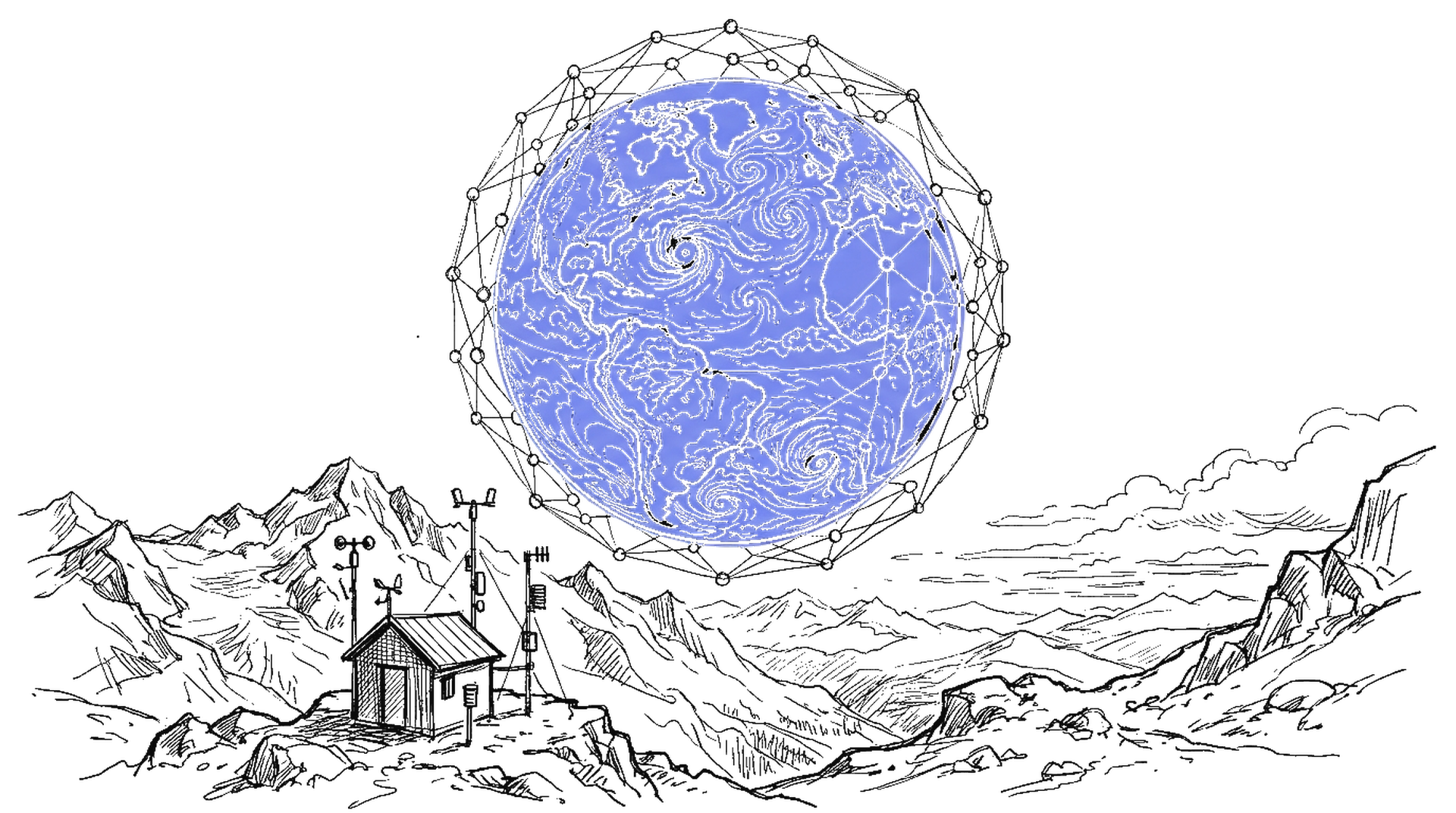

Während die KI-Branche immer grössere Modelle baut, geht CERN den umgekehrten Weg: Ultrakompakte KI-Modelle, physisch in FPGAs eingebrannt, filtern die gewaltige Datenmenge des Large Hadron Collider in Echtzeit. Der Kontrast zum «Bigger is Better»-Trend könnte kaum grösser sein.

40’000 Exabytes pro Jahr, 50 Nanosekunden Entscheidungszeit

Der LHC erzeugt 40 Millionen Teilchenkollisionen pro Sekunde. Nur ein winziger Bruchteil – rund 0,02 % der Events – enthält physikalisch interessante Daten. Den Rest aussortieren? Dafür hat das System weniger als 50 Nanosekunden Zeit pro Entscheidung.

Die Lösung: Rund 1’000 FPGAs (Field-Programmable Gate Arrays) – spezialisierte Chips, in die KI-Modelle direkt als Hardware-Schaltkreise «eingebrannt» werden. Keine Software, keine GPU, kein Betriebssystem. Reine Silizium-Logik.

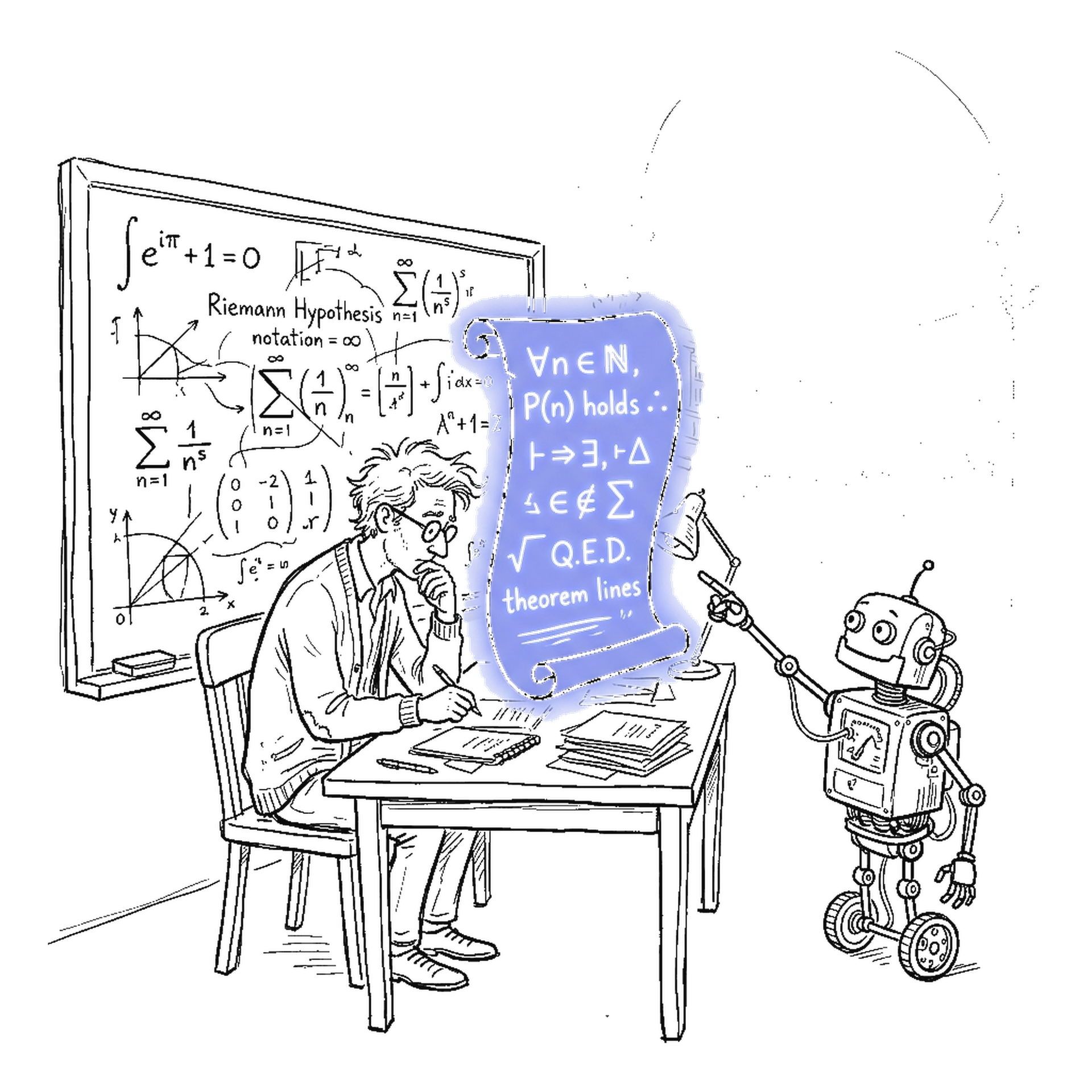

HLS4ML: Von PyTorch direkt in den Chip

Das Open-Source-Tool HLS4ML (High-Level Synthesis for Machine Learning) macht das möglich. Es kompiliert Standard-ML-Modelle aus PyTorch oder TensorFlow in synthetisierbares C++, das direkt in FPGA-Firmware umgewandelt wird. Entwickelt wurde es von einer Kooperation zwischen Fermilab, CERN, MIT und weiteren Institutionen.

Bemerkenswert: Tree-based Models (Entscheidungsbäume) übertreffen bei CERNs Anwendungsfall Deep-Learning-Ansätze – bei einem Bruchteil der Kosten und Energieverbrauch.

Warum das über die Physik hinaus relevant ist

Der Beitrag wurde am 3. April zum meistdiskutierten auf Hacker News (208+ Upvotes). Die Community-Debatte dreht sich um den Kontrast: Während Tech-Konzerne Milliarden in immer grössere Modelle stecken, beweist CERN, dass winzige, spezialisierte Modelle für bestimmte Aufgaben überlegen sind.

Für KI-Anwender die Lektion: Nicht jedes Problem braucht ein 1-Billion-Parameter-Modell. Manchmal reicht ein Entscheidungsbaum, der in Silizium läuft – wenn man das Problem gut genug versteht.