Sakana AIs «AI Scientist» hat den Peer-Review-Prozess von Nature bestanden. Zum ersten Mal veröffentlicht das renommierteste Wissenschaftsjournal der Welt eine Studie über ein System, das eigenständig forscht – von der Idee bis zum fertigen Paper.

Sakana AIs AI Scientist hat den Nature-Peer-Review bestanden – und ein begleitendes Editorial fordert neue Regeln für KI-generierte Forschung.

Sakana AIs «AI Scientist» hat den Peer-Review-Prozess von Nature bestanden. Zum ersten Mal überhaupt veröffentlicht das renommierteste Wissenschaftsjournal der Welt eine Studie über ein System, das eigenständig forscht – von der Idee bis zum fertigen Paper. Nature selbst fordert im begleitenden Editorial neue Regeln.

Der AI Scientist von Sakana AI – entwickelt gemeinsam mit der University of British Columbia, dem Vector Institute und der University of Oxford – ist das erste KI-System, das den kompletten wissenschaftlichen Zyklus autonom bewältigt: Forschungsfragen generieren, Literatur durchsuchen, Experimente designen und durchführen, Ergebnisse analysieren und ein vollständiges Paper in LaTeX schreiben.

Am 26. März 2026 publizierte Nature die umfassende Beschreibung dieses Systems als Open-Access-Studie. Zu den Autoren gehört unter anderem Jeff Clune, einer der einflussreichsten KI-Forscher der letzten Dekade.

Die beeindruckendste Zahl: Ein vollständig KI-generiertes Paper – ohne jegliche menschliche Nachbearbeitung – wurde dem Blind-Peer-Review des ICLR-2025-Workshops «I Can’t Believe It’s Not Better» unterzogen. Das Ergebnis: ein Durchschnittsscore von 6,33 (Einzelwertungen: 6, 7, 6). Das liegt über der menschlichen Akzeptanzschwelle und besser als 55 Prozent der von Menschen verfassten Papers im selben Prozess.

Zusätzlich zeigt das Paper eine klare Skalierungsregel: Je leistungsfähiger das zugrunde liegende Foundation-Modell, desto besser die Qualität der generierten Forschung. Das bedeutet: Mit jedem neuen Modell-Upgrade wird der AI Scientist automatisch besser.

In einem begleitenden Editorial vom 25. März fordert Nature Institutionen, Geldgeber und Verlage auf, jetzt zu handeln. Die Kernsorgen:

Nature warnt: Die Automatisierung drohe, «bereits fragile Forschungsintegrität» weiter zu untergraben – durch Paper-Mühlen, verzerrte Outputs und opake Trainingsdaten.

Die Autoren selbst sind ehrlich über die Grenzen: Der AI Scientist produziert manchmal naive Ideen, kämpft mit methodischer Strenge und ist anfällig für Halluzinationen. Sie empfehlen Wasserzeichen für KI-generierte Papers und neue Community-Standards.

Für Schweizer Forschende an ETH und EPFL stellt sich die Frage: Wird der AI Scientist ein Werkzeug, das die Produktivität explodieren lässt – oder ein Konkurrent, der den Wert menschlicher Forschung untergräbt? Die Antwort liegt vermutlich dazwischen. Klar ist: Die Art, wie wir Wissenschaft betreiben, verändert sich gerade fundamental. Und die Regeln dafür existieren noch nicht.

Sakana AIs AI Scientist hat den Nature-Peer-Review bestanden – und ein begleitendes Editorial fordert neue Regeln für KI-generierte Forschung.

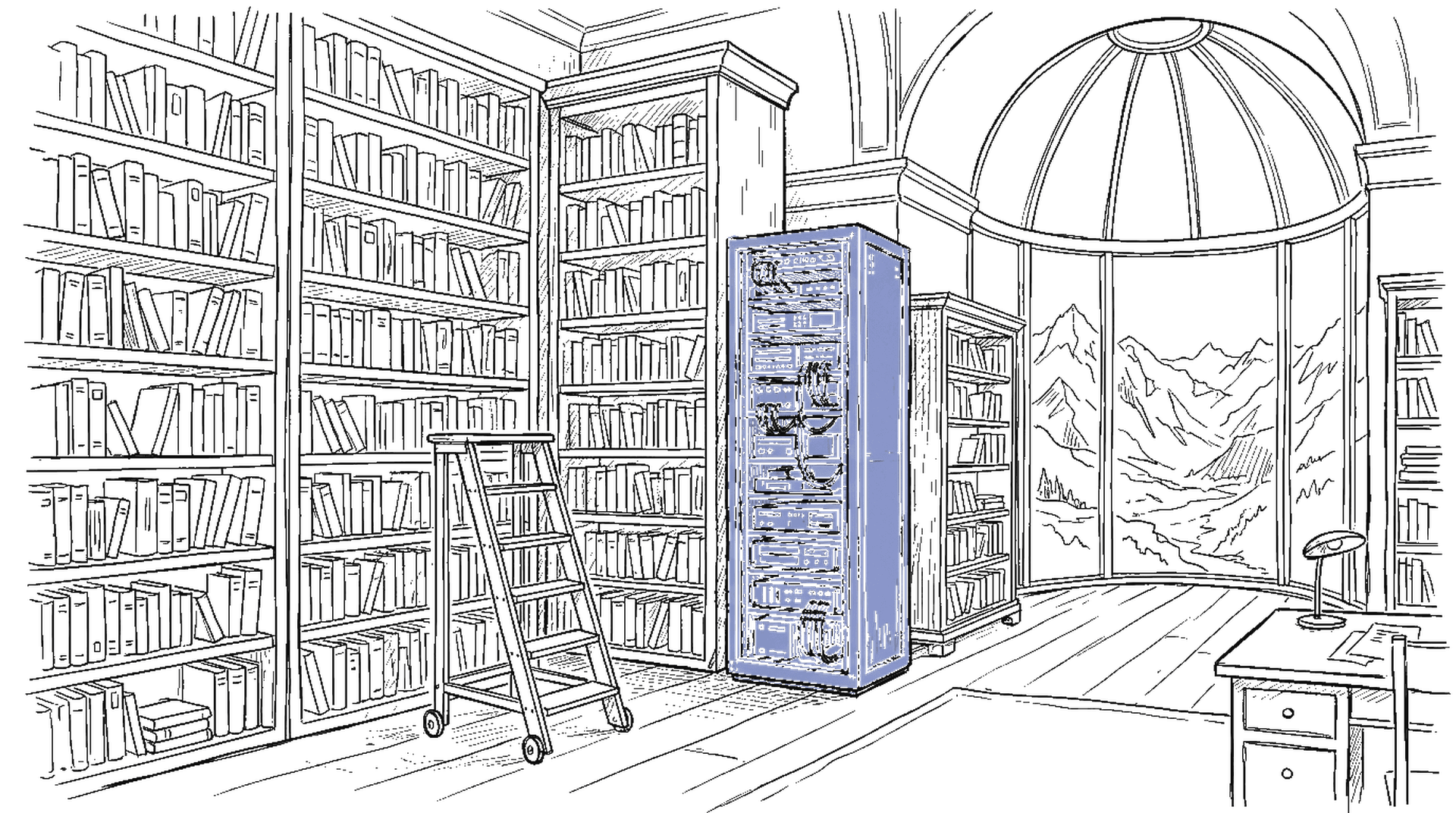

Die Stiftung Internet Archive Switzerland nimmt im Mai 2026 ihre Arbeit mit Sitz in St. Gallen auf und kooperiert mit der HSG, um sämtliche KI-Modelle zu archivieren. Eine zweite Initiative rettet bedrohte Archive weltweit.

Die Schweiz wird Standort für ein globales Digital-Archiv – inklusive einer einzigartigen Mission, jedes verfügbare KI-Modell für die Nachwelt zu sichern.

CCP Games heisst seit dem 6. Mai 2026 Fenris Creations, ist unabhängig von Pearl Abyss – und hat Google DeepMind als Minderheits-Investor. Das KI-Labor will mit Eve Online Long-Horizon-Planning, Memory und Continual Learning trainieren.

DeepMind macht aus 22 Jahren MMO-Wirtschaft eine Trainingsumgebung für Agenten, die langfristig planen, sich erinnern und kontinuierlich lernen.

Anthropic-CEO Amodei warnt: Sechs bis zwölf Monate Zeit, bevor chinesische KI gleichzieht. Mythos liefert nicht nur Schwachstellen, sondern den lauffähigen Exploit gleich mit.

Patch-Geschwindigkeit wird zum Wettbewerbsfaktor – wer Updates über Tage liegen lässt, fängt sich KI-generierte Exploits ein.